ait-deutschland GmbH - Big Data IoT Platform

ait-deutschland schafft die Basis für effiziente Big Data Analysen und legt den Grundstein für datengetriebene Geschäftsmodelle

Die ait-deutschland GmbH ist einer der führenden deutschen Hersteller für Heiz- und Kühllösungen. Die Kernkompetenz liegt in der Entwicklung von Wärmepumpen und Chillern für private und gewerbliche Zwecke. Zu den Produktmarken der ait-deutschland GmbH gehört „alpha Innotec“, „NOVELAN“ und „KKT chillers“.

Abbildung 1: Produktmarken ait-deutschland GmbH (Quelle: www.aitgroup.com)

Ausgangssituation und Herausforderung

Auf Grund des außergewöhnlich starken Wachstums der Branche und dem hohen Bedarf an Wärmepumpen, kommen dem Service und der Unterstützung von Fachhandwerkern eine immer größere Bedeutung zu. ait hat bereits vor vielen Jahren mit der Erfassung von Betriebsdaten ihrer Wärmepumpen begonnen. Mit Hilfe dieser Daten können Fachhandwerker und Servicetechniker von ait schneller Fehler erkennen und Probleme lösen. Bisher werden die Daten zentral auf einem Server der ait gespeichert. Für Datenauswertungen, vor allem von historischen Daten, müssen die Daten jedoch in einem aufwändigen Prozess manuell bereitgestellt, umgewandelt, angereichert und ausgewertet werden (u.a. mit Hilfe von Python und Microsoft Power BI). Analysen sehr großer Datenmengen, z.B. Zeitreihen eines bestimmten Typs, fordern auf Grund der großen Datenmengen einen unverhältnismäßig hohe Aufwand an Zeit und Personal und sind somit praktisch nicht möglich.

Lösungsbeitrag und Umsetzung

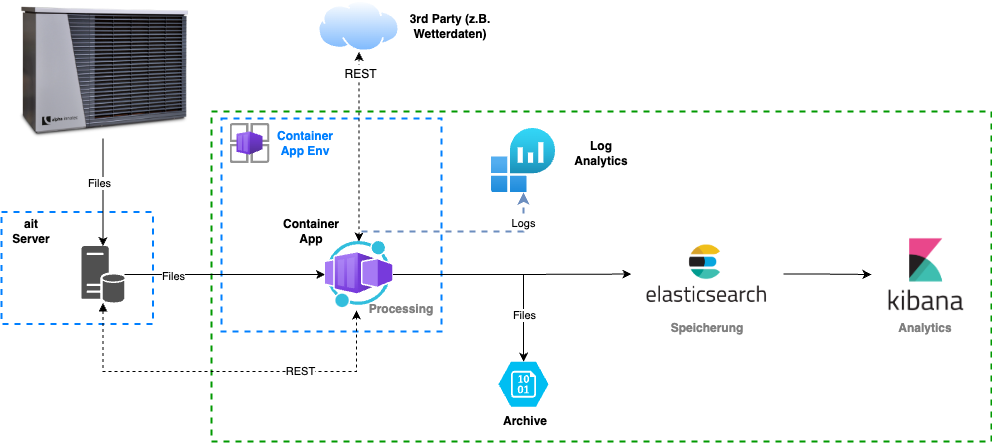

Die Lösungskonzeption sieht vor, den manuellen Aufwand durch Datenbewirtschaftung, Umwandlung und Anreicherung zum einen zu automatisieren, und zum anderen eine Datenplattform zu wählen, die mit großen Datenmengen umgehen kann. Die Wahl ist an dieser Stelle auf den Elastic-Stack gefallen. der es erlaubt, schnelle und effiziente Aggregationen und Visualisierungen zu erstellen. Mit dem integrierten Analysetool Kibana können die technischen Experten und Servicemitarbeiter rasch Dashboards mit wichtigen Metriken und Kennlinien erstellen und so effizient mit großen Datenmengen umgehen.

Um manuelle Aufwände beim Data Offloading des Servers zu umgehen, wurde der Server über eine REST–Schnittstelle angebunden. Mit periodischer Abfrage nach neuen Daten werden neu eingelaufene Datenpakete automatisch prozessiert und in den Elastic-Index überführt.

Abbildung 2: Big Data Architektur

Hier können Auswertungen und Visualisierungen schnell und einfach erstellt werden. Der Data Offload, die Prozessierung und Anreicherung der Daten und der Data Upload in den Elastic-Stack wurden mit einer Microsoft Azure Container App realisiert.

Der Vorteil der Container App liegt darin, dass diese sehr leichtgewichtig ausgerollt und betrieben werden kann und anhand der Auslastung dynamisch skalieren kann. Der Entwicklungs- und Deployment-Prozess für die notwendigen Infrastrukturkomponenten wird durch parametrisierte Pipelines auf Basis von Microsoft Azure DevOps realisiert.

Die Infrastruktur-Ressourcen der Azure-Cloud sind modularisiert, so dass sie mit Hilfe von Hashicorp Terraform (Infrastructure as Code) automatisch und transparent verwaltet werden können. Dies reduziert den Vendor Lockin auf den Cloud-Anbieter spürbar und macht die Lösung transportabel für andere Umgebungen

Ergebnisse und Ausblick

Durch die Ablösung der manuellen Datenprozesse sowie die automatisierte Anbindung zum Elastic-Stack spart ait deutlich Aufwände bei der Analyse ihrer Betriebsdaten und kann so leichter und einfacher wichtige Erkenntnisse sowohl für F&E als auch für Qualitäts- und Servicezwecke gewinnen. Die neue Plattform bietet weitreichende Integrationsmöglichkeit für weitere Daten (bspw. Wetterdaten), die mit den bestehenden Maschinendaten intelligent verknüpft werden können, um die Aussagekraft weiter zu erhöhen. Mit der neu geschaffenen Datenplattform hat ait eine skalierbare und zukunftssichere Ausgangsposition für digitale und datengetriebene Geschäftsszenarien entwickelt. Perspektivisch ist so die Grundlage für maschinelles Lernen gelegt, um zukünftig auch über Themen wie Predictive Maintenance noch besseren Service leisten zu und Ausfallzeiten im Vorfeld vermeiden zu können.

„Daten werden in Zukunft immer wichtiger. Um Daten in Zukunft effizient und zielgerichtet für unterschiedliche Unternehmensbereiche sinnvoll zu nutzen, haben wir colenio beauftragt, eine zukunftsfähige Datenarchitektur und Analysemöglichkeit zu schaffen. Wir schätzen den hohen Grad an technischer Expertise und Branchen-Know-How, sowie die pragmatische und ehrliche Herangehensweise.“

Jürgen Guttmann (Head of Digitalisation)